ไม่ว่าจะยุคใดสมัยใด มนุษย์ย่อมเรียกร้องหาการตัดสินใจที่เป็นธรรม มีหลักเกณฑ์ชัดเจน ไม่ใช้อารมณ์ความรู้สึกร่วมมาตัดสิน หากข้อเท็จจริงของสองกรณีเหมือนกัน ก็ต้องมีการตัดสินเหมือนกัน ไม่ว่าจะเป็นการตัดสินใจในทางธุรกิจ การเมือง หรือกฎหมาย โดยเฉพาะในระบบกฎหมายลายลักษณ์อักษร (Civil Law) ที่ไทยใช้อยู่

อย่างไรก็ดี คนทั่วไป นักธุรกิจ หรือกระทั่งผู้พิพากษา ไม่ใช่ตัวละครสมมติที่เราจะกำหนดให้มีการตัดสินใจที่เป็นธรรมที่สุดได้อยู่ตลอดเวลา เพราะเป็นไปได้เสมอว่าการตัดสินใจต่างๆ อาจมีปัจจัยภายนอกบางอย่างรบกวน การตัดสินใจเรื่องใหญ่ๆ ในชีวิตบางครั้งจึงต้องพึ่งศาสนา พระเจ้า หรือดวง ซึ่งมักถูกเชื่อว่ายุติธรรมกับมนุษย์ทุกคนเท่าเทียมกัน

แต่ในปัจจุบัน คอมพิวเตอร์มีประสิทธิภาพสูง และยังสามารถตัดสินใจได้ด้วยปัญญาประดิษฐ์ (AI) นอกจากนี้ คอมพิวเตอร์ยังไม่มีความรู้สึก ไม่เหนื่อย ไม่ต้องพักผ่อน ด้วยเหตุนี้ นักวิทยาศาสตร์การตัดสินใจจึงเริ่มสนใจที่จะใช้ AI ในฐานะผู้ช่วยตัดสินใจ โดยเชื่อว่าจะทำให้การตัดสินใจของมนุษย์แม่นยำ มีกฎเกณฑ์ และนำไปสู่ความเป็นธรรมมากขึ้น

ผู้พิพากษาก็โมโหหิวเป็น

ปัญหาผู้พิพากษาไม่หนักแน่นไม่ได้มีเฉพาะในประเทศไทย แต่เป็นปรากฏการณ์ที่เห็นได้ทั่วไป เพราะผู้พิพากษาต้องทำงานอย่างหนัก ตัดสินเรื่องใหญ่ๆ ครั้งแล้วครั้งเล่า ทั้งที่สมองมนุษย์เองไม่สามารถทำงานได้เต็มประสิทธิภาพตลอดเวลา

นักวิจัย[i] ได้ทำการศึกษาคำพิพากษาจำนวน 1,112 ครั้ง จากผู้พากษาชาวยิว-อิสราเอลจำนวน 8 คน โดยที่ผู้พิพากษาเหล่านี้จะต้องตัดสินโดย ‘ยอมรับ’ หรือ ‘ปฏิเสธ’ คำขอร้องของนักโทษ อาทิ การตัดทัณฑ์บน การขอถอดเครื่องติดตามตัว หรือการขอปรับสภาพความเป็นอยู่

การศึกษานี้ตั้งอยู่บนสมมติฐานว่า การตัดสินใจยากๆ ติดต่อกัน จะทำให้สมองล้าและตัดสินใจได้แย่ลง (Mental Depletion) เมื่อสมองล้าลง ก็จะเริ่มหาทางลัดโดยใช้ ‘การยอมรับค่าตั้งต้น’ (Default Options)

ตัวอย่างของสถานการณ์นี้คือการที่ผู้บริโภคจำเป็นต้องตัดสินใจเลือกสินค้าที่มีรายละเอียดหลายอย่าง ส่งผลให้สมองล้า และล้มเลิกความพยายามตัดสินใจ ยอมเลือกตามที่ผู้ขายเสนอซึ่งถือเป็น ‘ค่าตั้งต้น’ ในที่สุด จึงนำไปสู่สมมติฐานว่า เมื่อผู้พิพากษาเหนื่อย ก็จะเลือกค่าตั้งต้นให้กับนักโทษ นั่นคือการให้พวกเขาอยู่อย่างเดิม หรือเท่ากับเป็นการ ‘ปฏิเสธ’ คำขอร้องนั่นเอง

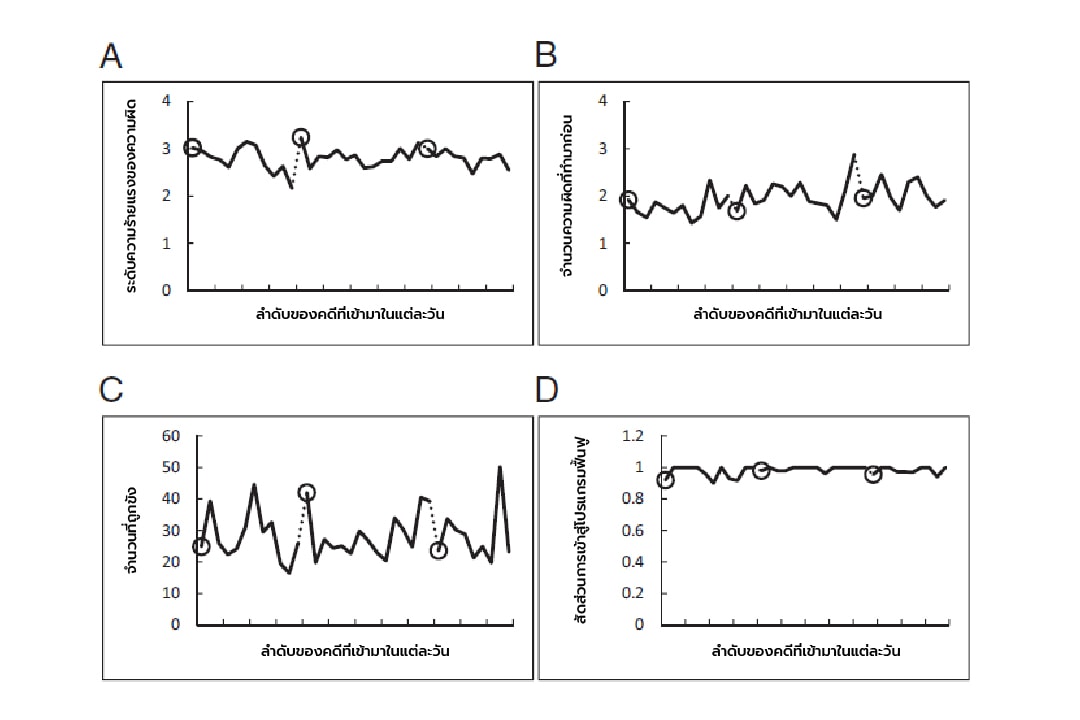

หากตัวผมได้เป็นผู้พิพากษา 10 เดือน (เท่ากับระยะเวลาในงานวิจัย) แล้วมีคดีต้องพิพากษาเข้ามาตลอดวัน โดยคดีที่เข้ามาตอนต้น กลางหรือท้ายวัน มีลักษณะที่ไม่ได้แตกต่างกันมากนัก ทั้งลักษณะความผิด จำนวนครั้งที่นักโทษเคยถูกจับกุมมาก่อน ระยะเวลาที่นักโทษอยู่ในคุก และการที่นักโทษเคยหรือไม่เคยเข้าโปรแกรมฟื้นฟูมาก่อน (ภาพ 1) ผมก็คงคิดว่าการตัดสินใจยอมรับหรือปฏิเสธคำขอร้องของนักโทษคงจะเฉลี่ยๆ เท่ากันไป ไม่ว่าจะเป็นคดีที่ต้องพิพากษาช่วงต้น กลางหรือท้ายวัน

หมายเหตุ: กราฟสี่กราฟนี้แสดงให้เห็นว่า คดีที่พิพากษาก่อน-หลังในแต่ละวัน ไม่ได้มีการเรียงลำดับความหนักของโทษหรือลักษณะนิสัยของนักโทษ และมีความหนักโดยเฉลี่ยเท่าๆ กันทุกวัน วงกลมซ้ายแสดงถึงคดีแรกที่ตัดสินในแต่ละวัน วงกลมที่สองแสดงคดีแรกที่ตัดสินหลังเบรกข้าวเช้า และวงกลมที่สามแสดงคดีแรกที่ตัดสินหลังจากเบรกข้าวเที่ยง

ที่มา: Danziger et al. (2011)

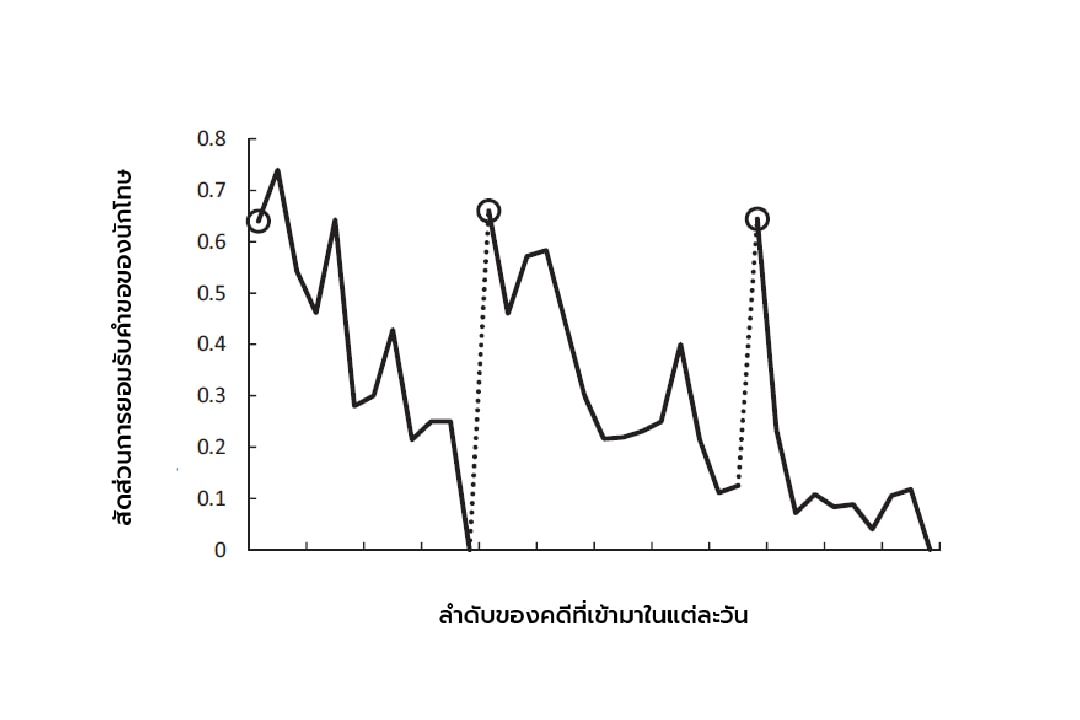

แต่โลกความเป็นจริงไม่ได้เป็นดั่งมโนภาพ เพราะผู้พิพากษาอิสราเอลใจดีเป็นพักๆ เท่านั้น กล่าวคือในช่วงเริ่มต้นเช้าวันใหม่ หลังจากพักเบรกทานอาหารเช้า และพักเบรกทานอาหารเที่ยงกลับมา มีค่าเฉลี่ยการยอมรับคำขอสูงถึง 50-60% แต่ความใจดีจะค่อยๆ ลดลง โดยเฉพาะช่วงก่อนจบเบรกเช้าและก่อนเลิกงาน โดยมีค่าเฉลี่ยลงไปอยู่ที่เกือบ 0% หรือปฏิเสธคำขอแทบทั้งหมด (ภาพ 2)

รูปแบบของการยอมรับคำขอร้องนี้ยังบ่งบอกว่า ความใจร้ายไม่ได้เพิ่มขึ้นตามคดีที่ต้องตัดสิน เพราะไม่เช่นนั้นเราคงจะเห็นตัวเลขที่ลดลงตามลำดับ ไม่มีการกระเด้งกลับขึ้นมา แต่รูปนี้แสดงให้เห็นว่า ผู้พิพากษาจะใจร้าย เมื่อเหนื่อยหรือหิว แต่เมื่อได้เบรกไปทานอะไรเสียหน่อย ก็จะกลับมาใจดีใหม่ได้สักพัก

หมายเหตุ: กราฟนี้แสดงให้เห็นว่าลำดับของคดีที่พิพากษามีผลอย่างมากต่อการตัดสินใจ (เฉลี่ยจากผู้พิพากษาอิสราเอล 8 คน เป็นเวลา 10 เดือน) โดยคดีแรก (วงกลมซ้ายสุด) มีเปอร์เซ็นต์ยอมรับคำขอของนักโทษสูงถึง 60% และลดลงตามลำดับ แต่จะกลับขึ้นมาสูงใหม่หลังจากได้ทานข้าวเช้า (วงกลมที่สอง) และเป็นแบบเดิมสำหรับการพักเบรกทานข้าวเที่ยงไปจนเลิกงาน

ที่มา: Danziger et al. (2011)

เพราะฉะนั้น คนที่ได้รับการพิจารณาคำขอระหว่างก่อนและหลังเบรกกินข้าว มีโอกาสที่จะได้ตามคำขอแตกต่างกันมาก ทั้งที่ความผิดและความประพฤติโดยเฉลี่ยของพวกเขาก็ไม่ได้แตกต่างกันมาก นี่จึงเป็นหลักฐานที่โต้แย้งได้อย่างชัดเจนว่า มนุษย์ไม่ได้มีการตัดสินที่เป็นธรรมเสมอไป หากการเบรกกินข้าวยังมีผลขนาดนี้ คงไม่ต้องคิดว่าปัจจัยอื่นๆ จะรบกวนการตัดสินใจได้มากขนาดไหน

ความเก๋าของผู้พิพากษา vs. AI ทำนายพฤติกรรม

ในสหรัฐอเมริกา ตำรวจจับผู้ต้องหาปีละกว่า 10 ล้านคน ขณะที่ผู้พิพากษาต้องตัดสินใจว่าจะให้ประกันตัวหรือไม่ โดยประเมินบนสมมติฐานว่า ผู้ต้องหาจะมีพฤติกรรมอย่างไรหากได้รับการประกันตัว ซึ่งผู้พิพากษาต้องทำนายพฤติกรรมนักโทษด้วยข้อมูลที่พวกเขามีอยู่ในหัว ถือเป็น ‘ประสบการณ์’ ที่ต้องสั่งสมกันมา

ขณะเดียวกัน การทำนายพฤติกรรมคนจากการใช้ข้อมูลในอดีตก็สามารถทำได้ด้วยเทคโนโลยี AI เช่นกัน[ii] จึงมีการนำเทคโนโลยีมาใช้ประเมินความเสี่ยงว่าผู้ต้องหาจะหนีคดีเมื่อได้รับการประกันตัวหรือไม่ โดยป้อนข้อมูลการประกันตัวของนครนิวยอร์กตั้งแต่ปี 2008-2013 และให้ข้อมูลเท่ากับที่ผู้พิพากษามีสำหรับการตัดสินใจเท่านั้น ไม่ว่าจะเป็นข้อมูลเกี่ยวกับรูปคดี หรือประวัติอาชญากรรมในอดีต (ผู้วิจัยเลือกตัดปัจจัยด้านเชื้อชาติ สีผิว และเพศ เพราะผิดกฎหมายสหรัฐอเมริกา)

ข้อมูลคดีมีมากถึง 221,876 ชุดที่ใช้สร้างแบบจำลองด้วย Machine Learning (Gradient Boosted Decision Trees) และมีข้อมูลอีก 110,938 ชุดที่เก็บไว้ใช้ทดสอบการทำนาย เพื่อดูว่าด้วยข้อมูลที่เท่ากันนี้ ผู้พิพากษาทำหน้าที่ได้ดีขนาดไหน และ AI จะช่วยยกระดับการประกันตัวได้หรือไม่

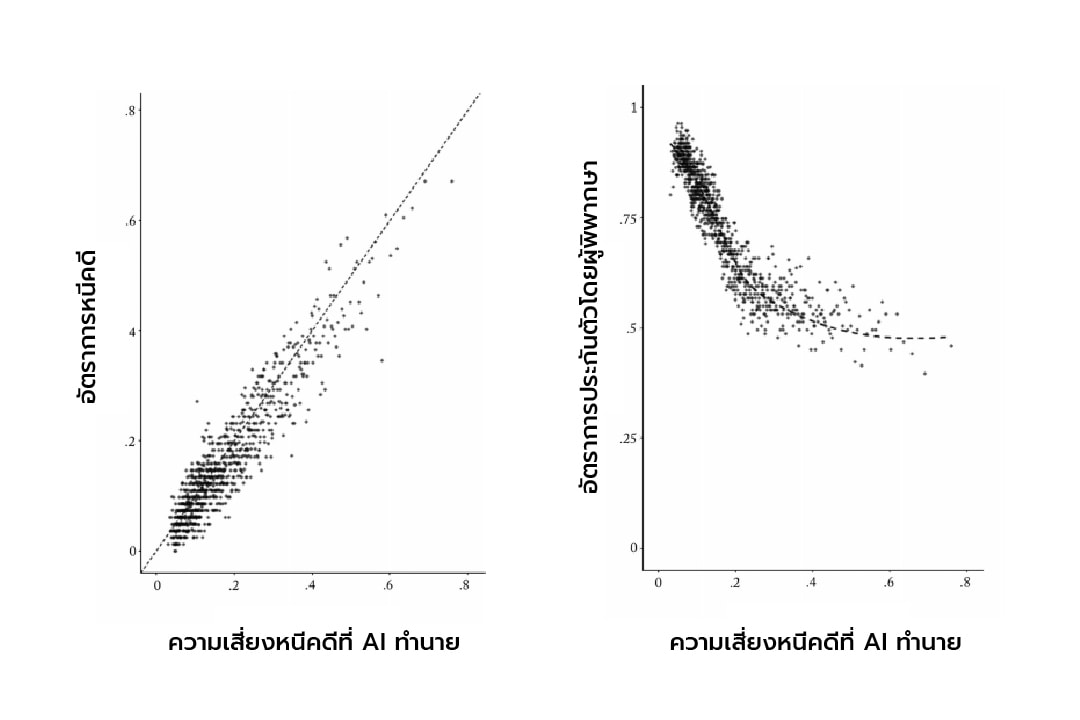

นักวิจัยพบว่าผู้พิพากษาให้ประกันตัวผู้ต้องหาหลายคนที่ AI บอกว่าเป็นผู้มีความเสี่ยงสูง โดยกลุ่มที่มีความเสี่ยงสูงสุด 1% ตามแบบจำลอง มีอัตราการหนีคดี 56.3% และถูกจับซ้ำ 62.7% แต่กลับเป็นกลุ่มที่ได้รับการประกันตัวมากถึง 48.5% นอกจากนี้ กลุ่มผู้พิพากษาที่เข้มงวดที่สุดไม่ได้ขังกลุ่มคนเสี่ยงสูงสุดให้หมดก่อนจะขังคนเสี่ยงรองลงมา แต่ขังคนในแต่ละกลุ่มความเสี่ยงคละกันไป

หมายเหตุ: ค่าความเสี่ยงการหนีคดี สำหรับในข้อมูลชุดที่เก็บไว้ทดสอบ แสดงให้เห็นว่า AI ทำนายอัตราการหนีคดีได้ค่อนข้างแม่นยำ มีความสัมพันธ์ที่เป็นบวกกับอัตราการหนีคดี แต่พบว่า กลุ่มที่มีความเสี่ยงสูงๆ ยังได้รับการประกันตัวจากผู้พิพากษามากถึง 50% ซึ่งเป็นการตัดสินใจที่ยังขาดประสิทธิภาพมาก

ที่มา: Kleinberg et al. (2018)

ด้วยจำนวนคนถูกขังที่เท่ากัน การประกันตัวตามที่ AI เสนอสามารถลดการหนีคดีได้มากถึง 14.4-24.7% หรือถ้าหากต้องการให้มีอัตราการเกิดคดีเท่าเดิม AI ก็สามารถลดอัตราการขังคนได้ 18.5-41.9% โดยผู้วิจัยเชื่อว่าผลลัพธ์แบบนี้ไม่ได้เกิดขึ้นเพียงกับกรณีของนิวยอร์ก แต่เกิดเหมือนกันทั้งประเทศ

งั้นเราใช้ AI เลยดีไหม?

การศึกษาเกี่ยวกับ AI หลายชิ้นพบว่า AI สามารถผลิตซ้ำการแบ่งแยกและความสองมาตรฐาน แม้ว่าจะไม่ได้ใช้อารมณ์ในการตัดสิน

ทำไมถึงเป็นเช่นนั้น?

เรื่องดังกล่าวมักเกิดขึ้นเพราะตัวข้อมูลที่ถูกนำมาใช้ในการฝึกแบบจำลองเอง ในสหรัฐอเมริกา การที่คนจนและคนผิวสีถูกจับกุมเพียงเพราะพวกเขาเป็นคนจนและผิวสีในอดีต ทำให้ข้อมูลของกลุ่มคนเหล่านี้ถูกบันทึกอยู่ในฐานข้อมูล จากนั้น เมื่อนำข้อมูลเหล่านี้มาใช้ในการฝึกแบบจำลอง AI ก็จะเข้าใจว่ากลุ่มคนเหล่านี้คือกลุ่มเสี่ยง ส่งผลให้ AI ตัดสินใจจับกุมคนเหล่านี้เพิ่มขึ้นกว่าคนกลุ่มอื่น และไปทำให้สัดส่วนของคนกลุ่มนี้ในฐานข้อมูลเพิ่มยิ่งขึ้นไปอีก

แม้ว่างานวิจัยที่นำเสนอไปข้างต้นจะตัดปัจจัยที่เกี่ยวข้องกับการแบ่งแยกออกไป อย่างเช่นสีผิว แต่ก็ต้องระวังว่ายังมีปัจจัยอื่นๆ ที่อาจมีความเชื่อมโยงอย่างมาก และมีผลให้เกิดอคติในการตัดสิน เช่น การอยู่ในพื้นที่ต่างกันซึ่งมีความบ่อยของการลาดตระเวนของตำรวจที่ต่างกัน นอกจากนี้ ต่อให้จะมีการปกปิดข้อมูลส่วนบุคคล แต่ข้อมูลทั่วๆ ไป อย่างการกดไลก์บนเฟสบุ๊ค ก็สามารถทำนายเชื้อชาติถูกต้องถึง 95% พรรคการเมืองที่ชอบ 85% และศาสนา 82% ในสหรัฐอเมริกา[iii] การปกปิดข้อมูลจึงอาจไม่มีประโยชน์ที่จะช่วยลดอคติในการตัดสินของ AI ได้

สำหรับประเทศไทย นักวิจัยที่ขยันอาจจะลองไปคัดข้อมูลการกระทำผิด การดำเนินคดี และการตัดสินใจให้ประกันตัวของศาลต่างๆ ทั่วไทย แต่ผู้วิจัยจะต้องระวังอย่างมาก เพราะว่าข้อมูลเหล่านี้ในฐานข้อมูลไทยอาจขึ้นกับสถานะทางเศรษฐกิจ และความสัมพันธ์ส่วนบุคคล หรืออาจมีคดีบางอย่างที่ศาล ‘ไม่กล้า’ จะให้ประกันตัว

ถ้าเป้าหมายของการพัฒนา AI เป็นไปเพื่อทำความเข้าใจการตัดสินของศาล ก็อาจจะทำให้สังคมได้เห็นความจริงที่ไม่กล้ายอมรับบางอย่าง แต่ถ้าคิดจะใช้ AI พัฒนากระบวนการยุติธรรม ก็จะต้องระวังให้มากขึ้นอีก 10 เท่า เพราะอาจเกิดการขังคนอย่างไม่เป็นธรรม “ที่มีประสิทธิภาพมากขึ้นกว่าเดิม”

อ้างอิง

[i] Danziger, Shai; Jonathan Levav; Liora Avnaim-Pesso. 2011. Extraneous Factors in Judicial Decisions. PNAS, vol. 108, no. 16.

[ii] Kleinberg, Jon; Himabindu Lakkaraju; Jure Leskovec; Jens Ludwig; Sendhil Mullainathan. 2018. Human Decisions and Machine Predictions. Quarterly Journal of Economics.

[iii] Federal Trade Commission. 2016. Big Data: A Tool for Inclusion or Exclusion?. FTA Report